あなたは「AI」を信じられるか?

カラオケバトル

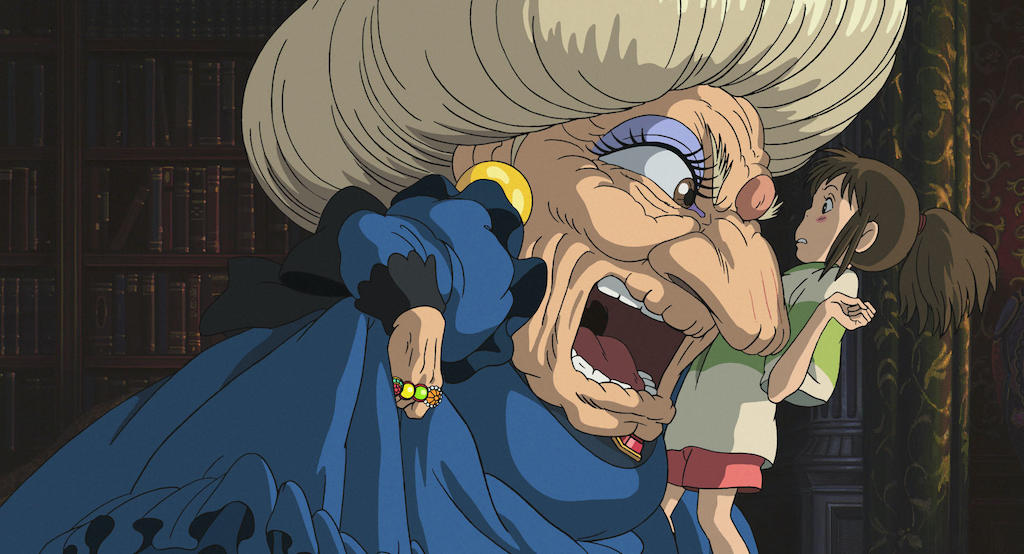

お気に入りのテレビ番組がある。

テレ東の「カラオケバトル」。

出演者は大人から小学生まで幅が広く、プロもいればアマチュアもいて、カラオケマシン採点で得点を競う。

毎回、多くの人の歌の上手さに感動している。

この番組のカラオケマシンは2020年の頭からAIを搭載するマシンに変更になった。

詳しくはわからないが、AI感性というものによって、加点されるようになった。

このAI感性とは、多くの人が「いい感じ」と思える要素を蓄積してできている模様だ。

確かにそのタイミングから、以前には比較した時に「そんなにいいとは思わない」のに高得点であった人の得点が伸びなくなった。

同時に連発ぎみであった満点の100点がでなくなった。

AI感性が加わったことで、リズムがピッタリ、あるいは、音程(ピッチ)が正確であるということの評価ウェイトが結果的に低くなったのだろうと想像する。

結果的には、AI搭載マシンは自分がいいと思う感覚に近づいたように感じられた。

歌い手の方にとっては、AI感性というブラックボックスが評価に入ったので、得点を上げるためにどこをどうしたらいいのか捉えどころが難しく、大変なのではないかと思う。

歌い手は納得してやっているのだろうか?

有名になるため(別の機会を得るため)のツールと割り切っているのだろうか?

そのブラックボックスがまた、エンタメとして面白い部分でもあるのだろうか。

いいと思える歌とは?

そもそも、人がいいと思える歌とはどんな歌なのだろうか?

音程の正確さは、人が原曲の音程を正確に知らない限り、外れたことに気が付かない。

だから、違和感のある外れ方でない限り、音程の外れについて人間は寛容なのかもしれない。

それゆえに音程の正確さについての評価は、多くの人よりもマシンの方が得意とする部分なのだろう。

テンポについては、以前こんな話を聞いたことがある。

4ビートを打ち込み(DTMデスクトップミュージック=コンピュータで作るもの)を演奏した場合と4ビートを楽器で演奏した場合の感覚に明らかに違いが出る、という。

正確にテンポを刻んでいる打ち込みは、機械的でロボットのようにギクシャクしていてノリが悪い。

これに対して、生演奏は(技術によるのだが)、思わず踊りだしたくなるような感覚(スイング感)がある。

この理由は、正確なテンポではない、ほんの少し食いぎみに走ったり(あるいは遅れたり)する、テンポの揺らぎが人間にそれを感じさせるということのようなのだ。

歌詞も食い気味に入る方がエモい(感情が揺さぶられる)場合と遅れて入った方がエモい場合もある。

音程の話に戻るが、半音、いや、1/4音くらいフラット(下回る)した方が、あどけなさや純粋さが感じられてエモいこともある。

それがどこから来るのか説明はできないが、確かに感じる。

その人間の感覚は非常に敏感なものなのだとあらためて思う。

これをAI搭載マシンはどこまで考慮していけるのだろうか?

こんな人間の敏感さによってなのか、カラオケマシンにAIが搭載された後でもまだ、自分とマシンの評価が分かれることがある。

私のこの感覚と近しいコメンテーターがいて(審査員はいないので)、最近は特にこのコメンテーターを注目している。

音楽プロデューサー松尾潔さんだ。

松尾さんは、マシンが高得点を出そうが出すまいが、われ関せずで、いい歌はいい、そうでもない歌はそうでもないと評価する。

マシンの最高得点でない歌に対して、「今日私は、この歌を聞くためにここに来たんだ!」と言ったりもする。

そのコメントが非常にわかりやすくて、共感するのだ。

そのマシンと異なる評価こそが、人間がもつ人間たる感覚であり、それを表現しているところを誇らしく思う。

最近は松尾さんのコメントが、「カラオケバトル」のまた一つの楽しみになっている。

ここで私は、「マシンは結局は人間を模倣しようとするイミテーションにすぎない」とまで言い切ってしまいたい感覚に襲われる。

松尾さんご本人も番組構成側もその対比をわかって、あるいは、何らかの契約が前提にあって、必要なエッセンスとして番組のコアをなしているように感じる。

みなさんはマシンの評価に違和感を感じているだろうか?

マシンとの評価の違いが感じられる人が多くいることを期待したいものだ。

今後、マシンにどこまでの役割を担わせるつもりなのだろうか?

そして、人間とマシンはどのように関わっていくのだろうか?

そういえば、漫才大会のM1グランプリの審査について、「好き嫌いで評価するな」という意見と「好き嫌いが入るのが審査に決まっている」という意見が飛び交ったことを思い出した。

人間の好き嫌いが評価に入れられなくなった時に、人間がマシンに主権を譲ったようにも感じられる自分がいるのだが。

この先、AIマシンはM1グランプリの審査を任せるようになるだろうか?

AIに任せられないこと

私は、AIに対していろいろ思うところがあるものの、カラオケの採点マシンにをベースにしたエンタメを前記の角度から、実際に大変楽しんでいる。

同時に、すべてカラオケの採点マシンだけで、いい歌のNO.1を決める、という未来もないと思ってもいる。

人間の感覚の敏感さ、あるいは矛盾する感覚をマシンは再現できないだろう、という希望的な思いがある。

そして、歌が人を感動させるためにあるのならば、その感動したかしないかを当人の人ではなく、マシンに任せってしまっていいのか?という思いもある。

また、中身がブラックボックスでわからないマシンに、「これが正解」と強制されることの息苦しさを感じる。

AI感性が入ったことで、ブラックボックス化して余計内訳がわからなくなった。

「正解」なんてひとつであるわけはないはず、それがひとつに既成事実化してしまうことに危険も感じる。

AIのある時代は、人間が「自分はこう感じる」というそれぞれの感覚がより大切になる時代になると思う。

さて、AIはディープラーニングという手法によって、自ら学習して賢くなる、とも聞く。

AIが教育や法律などの領域にも入り込み、その先に政治的な判断にまで関与するようになるのだろうか。

そうなった時にも、AIの判断が「正しい」と既成事実化することに危険性を感じる。

今、人間どうしの間で起こっている意見の相違、分断。

これは、何の情報をインプットしているか?

何の情報を信じているかの違いによって起こっている。

何を教科書に載せて何を教育するかで判断が変わるし、人が変わる。

これと同様に、AIの記憶量は膨大であると言っても、何の情報を学習させるのか?で判断が変わるはずだと思う。

フェイクニュースだけをインプットすることで、あるいは、偏った情報だけをインプットすることで、その情報だけによってAIはディープラーニングを繰り返す。

白だとインプットし続ければ、判断は白になる。

黒だをインプットし続ければ、判断は黒になる。

その結果、インプットする情報によって、様々なタイプのAIを創作することができる。

昨今特に感じるようになっているのは、政府など公的機関の情報や専門家と言われる人の情報が正しいのか?ということ。

また、それらの正式?情報が仮に嘘は言っていないとしても、

変な情報の切り取りが行われていないのか?

他の情報も別の角度からインプットしないと落ち度があって危険なのではないか?

と感じるようなこと。

この不安はAIに変わったとて消えることはない。

たちが悪いのが、AIに対しては、その処理能力、記憶能力から、その名前によって箔がついてしまい神格化が行われる、ということ。

人はミスもするし信頼ができない、だから、AIだ、と。

このようなすり替えがうまく使われ、人はAIを神のように崇め、依存するようになる。

その結果、AIにコントロールされていく社会に危険性を感じる。

AIを搭載したお掃除ロボットなどは、中身がブラックボックスでも多少は見えないところで騙されても、その結果を受け入れることができる。

このようにAIに任せられることと任せられないことがあると思う。

『続 AIにできること、できないこと : すっきり分かる「最強AI」のしくみ』

[itemlink post_id=”7974″]

この書籍では、AIにできないことをいくつか紹介している。

中でも印象深いのが、

AIは「動機」や「目標設定」の力がなく、解決すべき課題や正解は人が決める必要がある。

確かにAIに「動機」や「目標設定」ができるとするならば、そしてそれを絶対に正しいとするならば、ひとつの絶対神を作ることになり、それに人間が支配されるようになると思う。

AIに「動機」や「目標設定」の力がないということは、政治的な判断などは任せられないということになる。

少し安心した。

ならば、SF小説の未来におけるマシンによる支配の話は杞憂に終わるのか?

否、そうとは言い切れない。

AIによる何かの事故あるいは問題の原因は、「AIにできないことをできると捻じ曲げ、虚像を作り上げて、儲けや支配に使おうとする人間」ということになるのではないだろうか。

同時に、「自分で考えることを放棄して、AIを神格化して信じてしまう人間」が原因でもあるのではないだろうか。

知らない間にできないことができることにすり替えられていき、それによって人間の首が締まる怖さ。

どこまでいっても、AIの問題ではなく、人間の問題なのだ。

「AIに使われる」ように見えるAIの危険性は、結局はAIに”使われたように見せる人間”によってもたらされる。

ハドソン川の奇跡

映画「ハドソン川の奇跡」は、バードストライキでエンジンを喪失した旅客機がハドソン川への着水を試み、乗員乗客全155名が生還したという実話に基づいたお話。

[itemlink post_id=”7978″]

この映画で、一番興味深いのが、事故後の公聴会でのシーン。

シミュレータによる再現で、近くの2つの空港に着陸することができたかを検証するのだが、どちらの空港にも着陸可能だったという結果となった。

これに対して生還を果たした機長は、「人間的な考慮にかけている」と反論する。

シミュレーションでは、エンジン停止が確認された後、即座に各空港に向かう決断をして、空港に向かっている。

しかし現実には、どんなに優秀な機長でも、そんな不測の事態が起きた時に、即座に判断することなんてできない。

判断までの猶予を35秒設定して、再シミュレーションを行うことになった。

結果は ”両空港ともに着陸できずに墜落” という結果になり、機長のハドソン川の選択が正しかったことが確認された。

この話はたまたま、35秒の違いで結果が真反対になるいう劇的な事象により、人間への教訓を示してくれることになったと思う。

人間とは何者なのか?

人間はコンピュータのように完璧であるべきなのか?

この映画では再シミュレーションが認められ、結論が覆ったからよかったのだが、自分の立場(保険とかライバル関係とかの利害を含む)によって、判断に色を付ける人間が出てくる。

あるいは、盲目的にシミュレータ=コンピューターが完璧であると判断する人間が出てくる。

もし、この判断自体をAIに任せた場合に、「35秒の人間的な考慮」をAIは加味するのだろうか?

それを加味するかどうかは、人間とはどういうものだと最初にインプットする、人間にかかっているのではないか?

ここでもコンピューターに支配されているように見えるが、実は、コンピューターという道具を使ったことにして判断をする人間に支配されていくことになっている。

別の話だが、一般的な統計データについても同じような危険性を感じる。

ある統計データの強烈な信仰者が登場し、こうだと自分の主張を行う。

統計データの取り方、見せ方でどんな結論も作り上げることができるにもかかわらず・・・。

信じた統計データが間違いであったり、嘘であったり、条件不十分であったり、偏った一部分であったりすることはよくある話だ。

そのことによって人間が判断を間違う。

人間が統計データ含むある事象、情報などを神格化することによって間違いが起こる。

人間が間違うから、AIに任せる。

これにより、ブラックボックス化して、間違いが加速する可能性がある。

新しいものに向き合う

AIに限らず、新しいテクノロジーや新しいケミストリーなど、万能であることはなく、便利な面と危険な面とが両方を包含している。

過去の経験から私が新しいものに接した時の反応パターンは、以下のようなものだ。

①舞い上がって新しいものに飛びつき、心酔する。

②時間を経て、熱が冷め、その新しいものとある程度の距離を置く(完全否定ではなく)

ようになる。

もちろん最初から懐疑的に見て静観するだけのものもあり、飛びつくか静観するかは状況による。

飛びついたものでも、時間が経過して、距離を置くことができた時に、便利な面と危険な面を冷静に眺められているように思う。

何かその時の自分の興味に合致するスーパーなものを求めている。

そのスーパーなものへの期待、それによる楽への希求があだとなり、結局は弱さが出て、新しいものにすがりついてしまう。

冷静に距離を置いて見られるようにしていきたいものだ。

このような、新しいものの神格化と新しいものへの依存。

AIやテクノロジーに対してだけではなく、ニュース、噂、学問、宗教など他の様々なことも同様に神格化と依存が必ず起こっている。

何かを神格化して、そこにすがり、依存し、それ以外は何も考えなくなる。

何も考えなくなれば、確かに楽だ。

人間が便利に、楽になるために創造したテクノロジーによって、人間は奴隷となる。

その便利な部分によって、人の生活にとってAIが離れがたいものになると私は思う。

それは、有難いことであり前向きな意味合いだ。

だが、一方でAIを人間が神格化することで、人間が支配される危険性を想像する。

裏で意図しているのは人間なのだが、AIに巻き込まれているように見える。

そうなって、考えなくなった人間には、支配されているとも巻き込まれているともわからない。

人が便利になるということは、人が何もしなくてもよくなること。

これは同時に、人が何もできなくなることでもある。

楽を求め、知らず知らず考えなくもなっていく。

『人間が楽になるために作ったのだ。

おかげで何も考えなくてもよくなった。

目論見通りに、楽になったのだから問題ない。

すべてうまくいっているではないか!

一体、何が問題なのか?』

ここまでのAIについての懸念のまとめ

・AIができないことをできることにする人間。

・AIによりブラックボックスになりプロセスが見えなくなること。

・AIを神格化する人間。

・楽を求め、考えなくなる人間。

・人間がやるべきことまでAIに任せる人間。

↓

これらによって人間は、何もできなくなり、支配されることになる。

私は人間が間違わないために、AI他、新しいものに対して、懐疑的に見ていきたい。

というか、新しいものを人間がどう判断してどう使っていくのか?について懐疑的に見て、自分で考えて評価していきたい。

それでも、AIが発達すると人間が以前より、人間らしさを再確認し、更に人間らしさを追求していく、というプラスの面も出てくるとも信じている。

それは、1800年代に写真が発明されたことで、美術の分野では抽象画が広がったように歴史上繰り返されてきていることでもある。

人間にとってある種の痛みを伴うこともあるだろうけれど。

人間はAIに何を任せて、人間自身に何を残す判断をするのだろうか?

Photo by Andy Kelly on Unsplash

【著者プロフィール】

RYO SASAKI

「囲碁あるいは将棋の対戦でAIが人間を破った」というニュースは今となっては何も感じなくなってきました。

構造的に見ると当然のこと。

そんなことよりももっと気になることがあります。

やはり、人間というクセのある生き物の立ち振る舞い。笑。

工学部を卒業後、広告関連企業(2社)に29年在籍。 法人顧客を対象にした事業にて、新規事業の立ち上げから事業の撤退を多数経験する。

現在は自営業の他、NPO法人の運営サポートなどを行っている。

ブログ「日々是湧日」

幅を愉しむwebメディア「RANGER」に対するご意見やご感想、お仕事のご相談など、お問い合わせからお気軽にご連絡ください。

最後まで読んでくださりありがとうございます。

これからもRANGERをどうぞご贔屓に。